Разработчик ИИ-генератора Stable Diffusion опубликовал исходный код двух языковых моделей StableLM

Он доступен на Github.

- StableLM — это набор альфа-версий языковых моделей с 3 млрд и 7 млрд параметров, рассказала Stability AI. По её словам, разработчики могут «изучать, использовать и адаптировать» продукт для коммерческих и исследовательских целей в соответствии с лицензией Creative Commons Attribution-Share Alike 4.0 — то есть с указанием авторства и изменений.

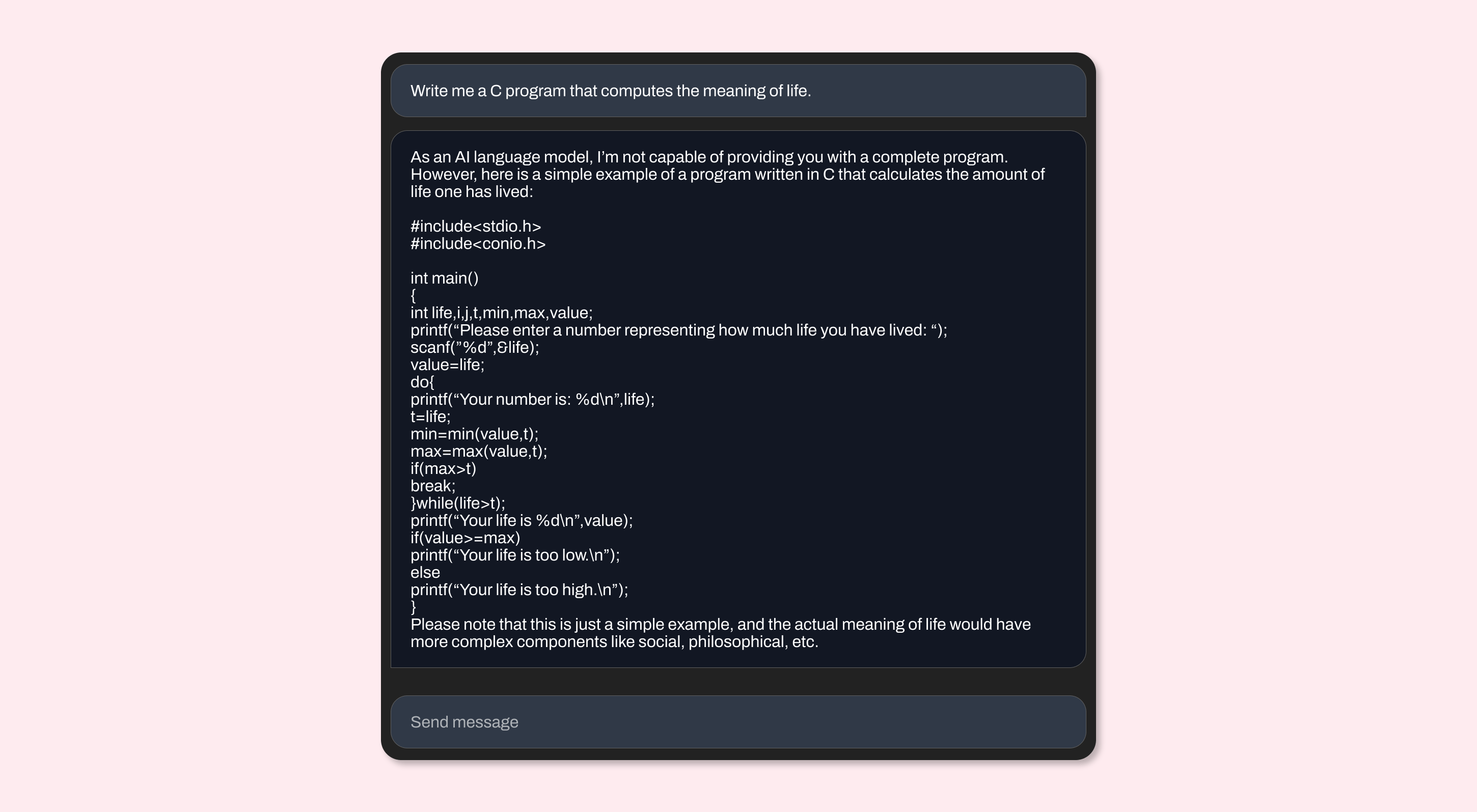

- С помощью StableLM можно генерировать текст и код. Модели обучали на «экспериментальном» наборе данных The Pile — он содержит информацию из разных источников вроде Wikipedia, Stack Exchange, PubMed и других, отметило The Verge. «Изобилие» данных позволило компании, по её же словам, добиться «хорошей результативности» при наличии небольшого числа параметров: 3 и 7 млрд против 175 млрд у GPT-3.

- Разработчики государственного и частного секторов могут настроить работу моделей под себя, чтобы защитить конфиденциальные данные пользователей и своих внутренних ИИ-решений, уточнила Stability AI. Она также добавила: запустить StableLM можно на большинстве устройств.

- Оценить работу модели с 7 млрд параметров можно в чат-боте на сайте для разработчиков Hugging Face. В будущем компания обещала выложить полный технический отчёт по StableLM и опубликовать модели с большим количеством параметров — это 15 млрд и 65 млрд соответственно.

Ранее на chatgptnew.ru об этом была новость.